~最新のAIセキュリティ情報を広く取得し一元化して発信、迅速なリスク対策に寄与~

KDDI株式会社

株式会社KDDI総合研究所

KDDIとKDDI総合研究所は2025年3月26日、大規模言語モデル(以下 LLM)を利用した新しい分類技術を開発・導入し、AIのセキュリティに関する情報を一元化して発信するポータルサイト「AIセキュリティポータル」(以下 本サイト)を公開しました。本サイトでは、最新のAIのセキュリティ情報が体系的に整理されており、利用者は自身が必要な最新情報を得ることが可能になります。

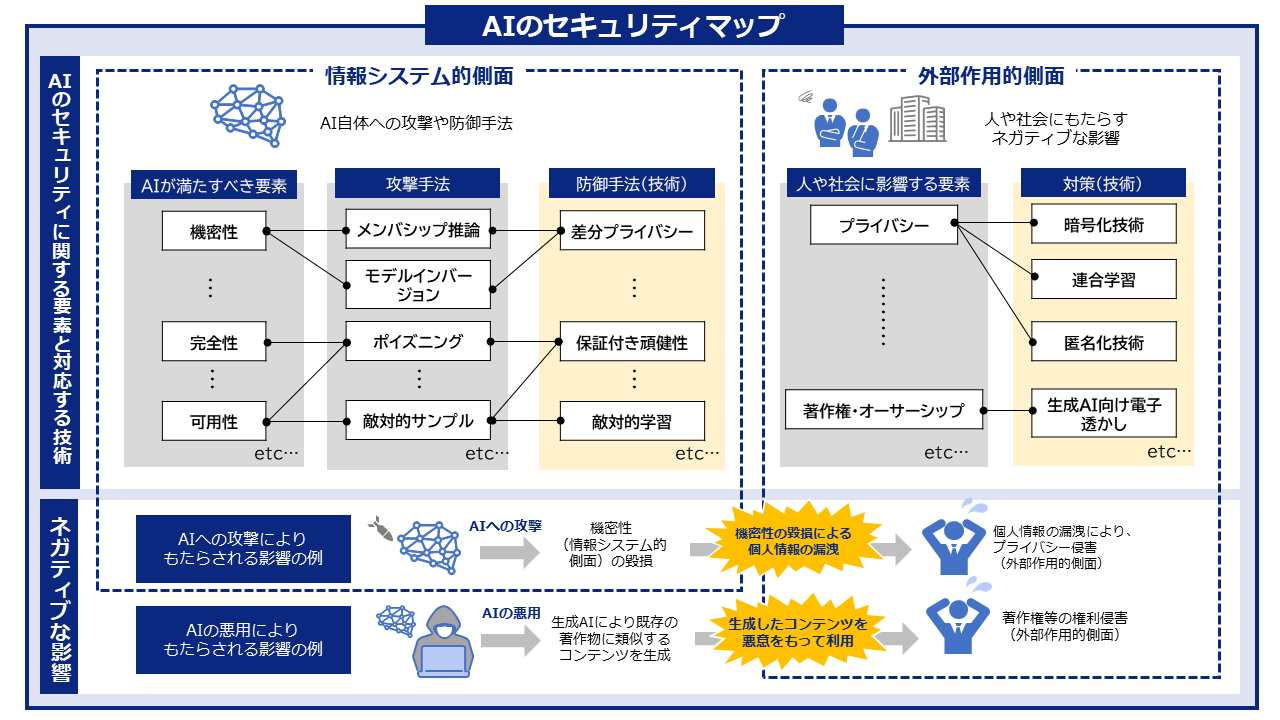

両社は、KDDIグループAI開発・利活用原則(![]() 注1)を踏まえ、AIのセキュリティに関する研究開発を進めています。本サイトでは、AI自体への攻撃や防御手法だけでなく、人や社会にもたらす影響とその対策となる技術について、Web上の最新情報を整理・分類、一元化し提供しています。

注1)を踏まえ、AIのセキュリティに関する研究開発を進めています。本サイトでは、AI自体への攻撃や防御手法だけでなく、人や社会にもたらす影響とその対策となる技術について、Web上の最新情報を整理・分類、一元化し提供しています。

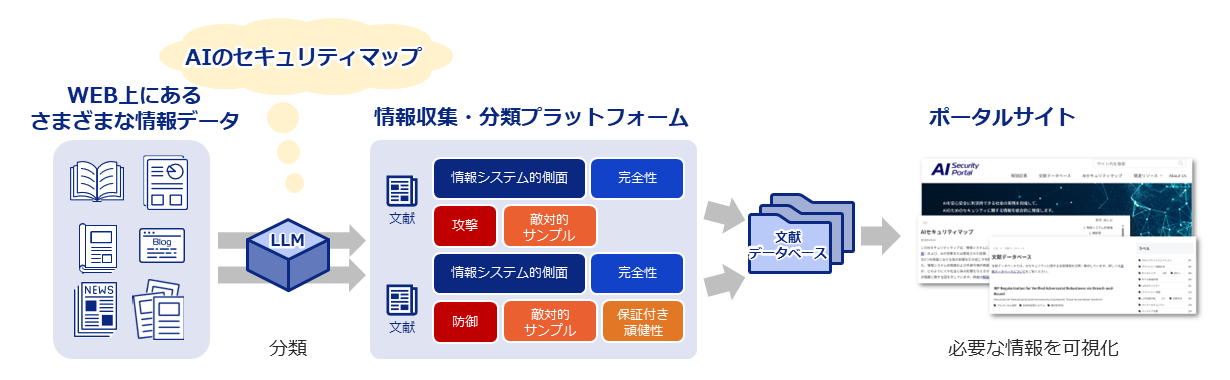

Web上にあるAIのセキュリティに関する膨大な文献情報を分類する際に、LLMを利用した新しい分類技術(![]() 注2)を今回開発し、導入しています。この技術は、Web上に日々公開される論文などの文献を分かりやすく整理するため、文献に適切なラベルを自動的に付与し分類する技術です(特許出願中)。これにより、これまで整理されていなかった最新のAIのセキュリティ情報を整理・分類することが可能になり、新しく出た文献も本サイトのデータベースに随時蓄積されることで、利用者が求める最新情報に簡単にアクセスできるようになります。

注2)を今回開発し、導入しています。この技術は、Web上に日々公開される論文などの文献を分かりやすく整理するため、文献に適切なラベルを自動的に付与し分類する技術です(特許出願中)。これにより、これまで整理されていなかった最新のAIのセキュリティ情報を整理・分類することが可能になり、新しく出た文献も本サイトのデータベースに随時蓄積されることで、利用者が求める最新情報に簡単にアクセスできるようになります。

■背景

近年、AIの社会実装が進む中で、特定の入力に対してのみAIを誤作動させるバックドア攻撃や、LLMから開発者が意図しない応答を出力させるプロンプトインジェクションなど、AIに対する攻撃や悪用への懸念が高まっています。そのため、AIの脆弱性を含むリスクの特定・検証および対応に関するセキュリティ技術の検討が、専門家の間で活発に行われています。

一方、AIのセキュリティは新しい研究分野であるため、体系的にまとめられた情報が少なく、AI研究やセキュリティ研究の幅広い観点から、多くの論文や研究開発動向を集約する必要があります。あらゆる人がAIを安全に活用できるようにするために、AIのセキュリティに関する知識や技術の最新情報を適時適切に得られる環境が求められています。政府は、経済安全保障重要技術育成プログラム(K Program)のもと、AIが浸透するデータ駆動型の経済社会に必要なAIセキュリティ技術の確立を進めています(![]() 注3)。

注3)。

KDDIグループは、2021年にAIを活用したお客さま体験価値のさらなる向上や社会の持続的発展に貢献するため、「KDDIグループAI開発・利活用原則」を策定し、あらゆる人がAIを安全に活用できるような環境の実現を進めています。2024年5月にはAIガバナンスの社会実装とポリシーメーカーなどとの連携強化を進めるAIガバナンス協会(本部:東京都中央区、代表理事:大柴 行人、生田目 雅史、羽深 宏樹、現 一般社団法人AIガバナンス協会)に参画(![]() 注4)、2025年2月には生成AIに係る国際的なルール形成を行う枠組みである「広島AIプロセス」において取りまとめられた国際行動規範について、その遵守状況をAI開発企業などが自ら確認し報告するための手法である「報告枠組み」への参画を表明(

注4)、2025年2月には生成AIに係る国際的なルール形成を行う枠組みである「広島AIプロセス」において取りまとめられた国際行動規範について、その遵守状況をAI開発企業などが自ら確認し報告するための手法である「報告枠組み」への参画を表明(![]() 注5)しています。

注5)しています。

■本サイトで提供する情報

本サイトでは、AIのセキュリティに関する全体像、個々の解説記事、文献情報、ニュースやイベント情報、関連サイトといったAIのセキュリティに関する情報を包括的に発信しています。利用者はこのサイトを起点としAIのセキュリティに関する最新情報を得ることが可能になります。

また、AIが攻撃・悪用された結果によるネガティブな影響を体系的に整理しているため、AIへの攻撃が人や社会に与える影響範囲を知ることができ、対策の検討に寄与することができます。

■本サイトの仕組み・特長

KDDI総合研究所は、AIのセキュリティに関する情報を集約し提供するため、Web上にあるAIのセキュリティに関する情報を、知識・技術の体系化により効率的に収集、整理できる知識集約環境を構築しました。

- 知識・技術の体系化(AIのセキュリティマップの作成)

AI技術の進歩に伴い増加するAIのセキュリティ情報を整理・分類するためには、関連知識や技術を体系化する必要があります。今回、AI自体への攻撃や防御手法(情報システム的側面)だけではなく、これまでAIのセキュリティとの関係性が体系的に整理されていなかった、プライバシー侵害や著作権などの権利侵害(外部作用的側面)など、AIが攻撃・悪用された結果によりAIが社会や人にもたらすネガティブな影響の要素の調査研究を行いました。この結果をもとに、AIのセキュリティ情報の関連性を整理したAIのセキュリティマップを作成しました。

<AIのセキュリティマップの概略>

- 情報収集・分類プラットフォームの構築

今回、Web上にあるAIのセキュリティに関する論文や学術会議、ブログ、SNSなどの膨大な情報を分類・集約するプラットフォームを構築しました。このプラットフォームでは、LLMを利用した新しい分類技術を開発・導入しています。

従来の分類技術では、AIモデルを学習させる際の良質な訓練データ( 注6)を大量に収集することが難しく、また、既存のデータベースに存在しない未知の文献に対して適切なラベルを付与できない問題がありました。今回の分類技術は、少量の教師データ(

注6)を大量に収集することが難しく、また、既存のデータベースに存在しない未知の文献に対して適切なラベルを付与できない問題がありました。今回の分類技術は、少量の教師データ( 注7)に基づく検索拡張の手法と、LLMへの入力時に新規ラベルの生成方法を提示するFew-shotプロンプティング(

注7)に基づく検索拡張の手法と、LLMへの入力時に新規ラベルの生成方法を提示するFew-shotプロンプティング( 注8)を用いることで、既存、新規それぞれの文献に対するラベル付けを可能にしました。

注8)を用いることで、既存、新規それぞれの文献に対するラベル付けを可能にしました。

<本サイトの仕組み>

KDDIとKDDI総合研究所は、今後も社会全体に向けAIのセキュリティの情報提供や注意喚起、リスク対策の普及啓発を推進していきます。

なお本サイトは、国立研究開発法人科学技術振興機構が進める経済安全保障重要技術育成プログラム(K Program)「人工知能(AI)が浸透するデータ駆動型の経済社会に必要なAIセキュリティ技術の確立」における研究開発課題「安心安全なAI利活用の為の知識・技術の体系化と知識集約環境構築」により実施した研究開発の成果のひとつです。この成果により、最新のAIのセキュリティの技術・知識を包括的かつ迅速に体系化した上で、高精度の自動収集・分類を通じた最適なリスクコミュニケーション(![]() 注9)手法を確立することが可能となり、研究開発構想が目標とする、AIのセキュリティに関する必要な知見蓄積や知識・技術体系の整理・獲得の実現に寄与します。

注9)手法を確立することが可能となり、研究開発構想が目標とする、AIのセキュリティに関する必要な知見蓄積や知識・技術体系の整理・獲得の実現に寄与します。

- 注1)

- 注2)LLMを活用し、学術論文などに文書ラベルを自動的に割り当てる技術

- 注3)

- 注4)

- 注5)

- 注6)機械学習やAIのモデルを構築・学習させるために使用されるデータのこと。

- 注7)機械学習モデルが正しい判断を学ぶために、入力とそれに対応する正しい出力(ラベル)が含まれたデータのこと。

- 注8)少ない例を使ってAIモデルに新しいタスクを教える方法のこと。

- 注9)リスクに関する正確な情報を、専門家や市民など、さまざまな関係者間で共有すること。

- ※この記事に記載された情報は、掲載日時点のものです。

商品・サービスの料金、サービス内容・仕様、お問い合わせ先などの情報は予告なしに変更されることがありますので、あらかじめご了承ください。

ダウンロード

関連記事